Voice Navigation macht E-Learning für alle zugänglich. Ob du blind bist, motorische Einschränkungen hast oder einfach freihändig lernen möchtest – sprachgesteuerte Systeme öffnen neue Wege zum Wissen.

Wir bei newroom connect sehen täglich, wie wichtig barrierefreie Lernplattformen sind. Dieser Beitrag zeigt dir, wie Voice Navigation funktioniert und wie du sie richtig einsetzt.

Warum Voice Navigation die Barrierefreiheit im E-Learning entscheidend verändert

Voice Navigation beseitigt die größten Hürden beim Zugang zu Lernmaterialien. Sehbehinderte und blinde Lernende können Kurse nun ohne Umwege öffnen, Kapitel springen oder Quizze starten – nur durch Sprachbefehle. Statt sich durch Menüs zu tasten oder auf Screenreader-Unterstützung zu warten, navigieren sie direkt zum gewünschten Inhalt. Das erspart Frustration und macht Lernen tatsächlich selbstbestimmt. Für Menschen mit motorischen Einschränkungen ist freihändige Navigation nicht optional, sondern essentiell. Sie können Kurse durcharbeiten, ohne Maus oder Tastatur zu bedienen, und das über längere Zeit ohne Ermüdung. Auch für alle anderen Lernenden wird Voice Navigation zur echten Alternative: Sie lernen während des Autofahrens, beim Kochen oder in anderen Situationen, in denen die Hände beschäftigt sind.

Sprachbefehle sparen messbar Zeit

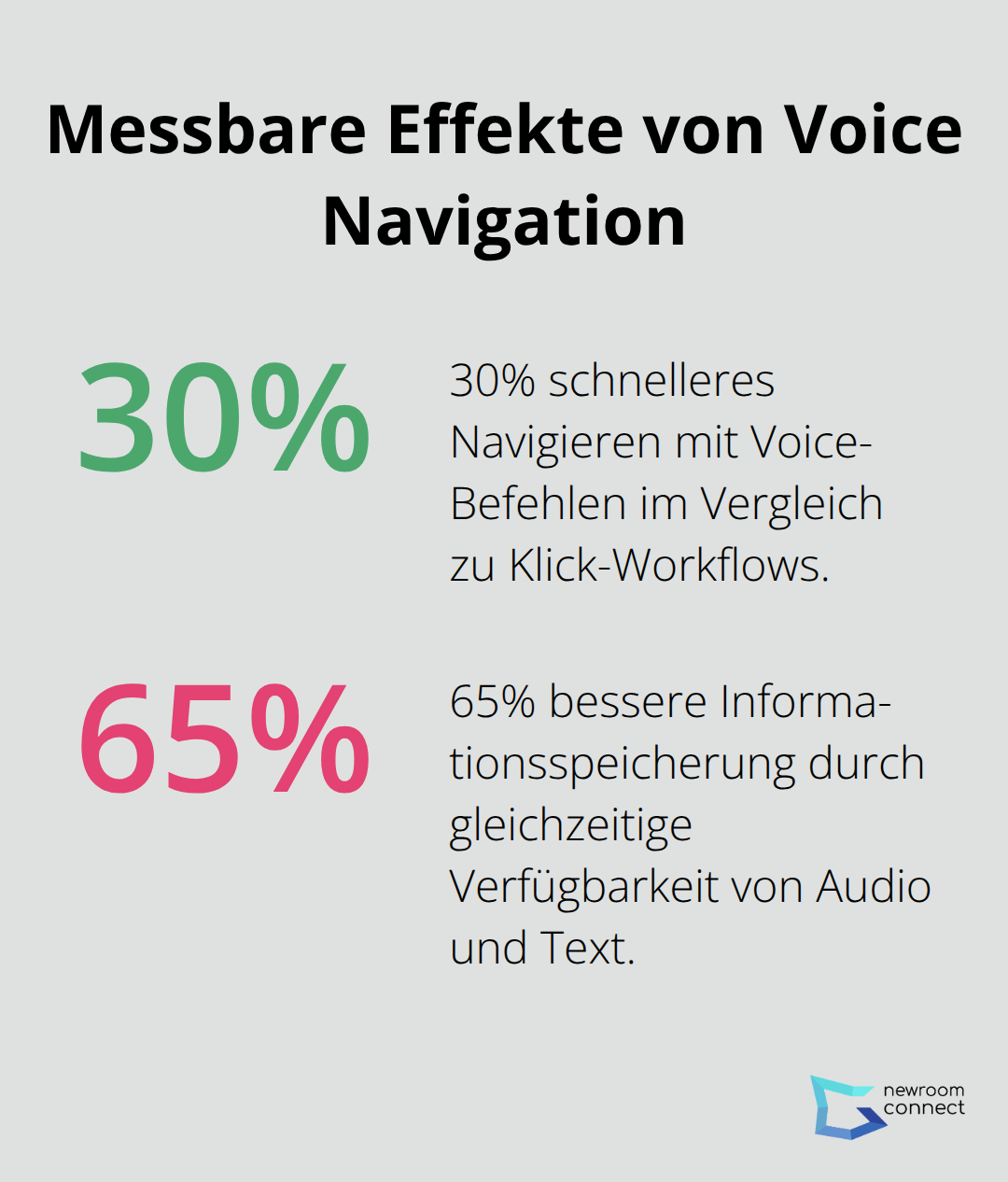

Sprachgesteuerte Navigation spart Zeit, die du sonst für Klicks brauchst. Statt drei bis vier Klicks zum gewünschten Kapitel reicht ein Sprachbefehl. Nutzer gelangen mit Voice-Befehlen durchschnittlich 30 Prozent schneller zu ihren Zielen als mit traditionellen Klick-Workflows. Das ist besonders wertvoll, wenn du wiederholt auf die gleichen Inhalte zugreifst.

Die Plattform kann auch proaktiv werden: Sie merkt sich, welche Kurse du häufig besuchst, und schlägt sie automatisch vor. Statt zu fragen, ob du das Quiz starten möchtest, kann die KI-Stimme sagen: „Du hast heute noch die Aufgabe zu Kapitel 5 offen – sollen wir sie jetzt machen?“ Das macht das Lernen intuitiver und reduziert die kognitive Belastung, die durch zu viele Wahlmöglichkeiten entsteht.

Barrierefreiheit braucht echte Integration, nicht Oberflächlichkeit

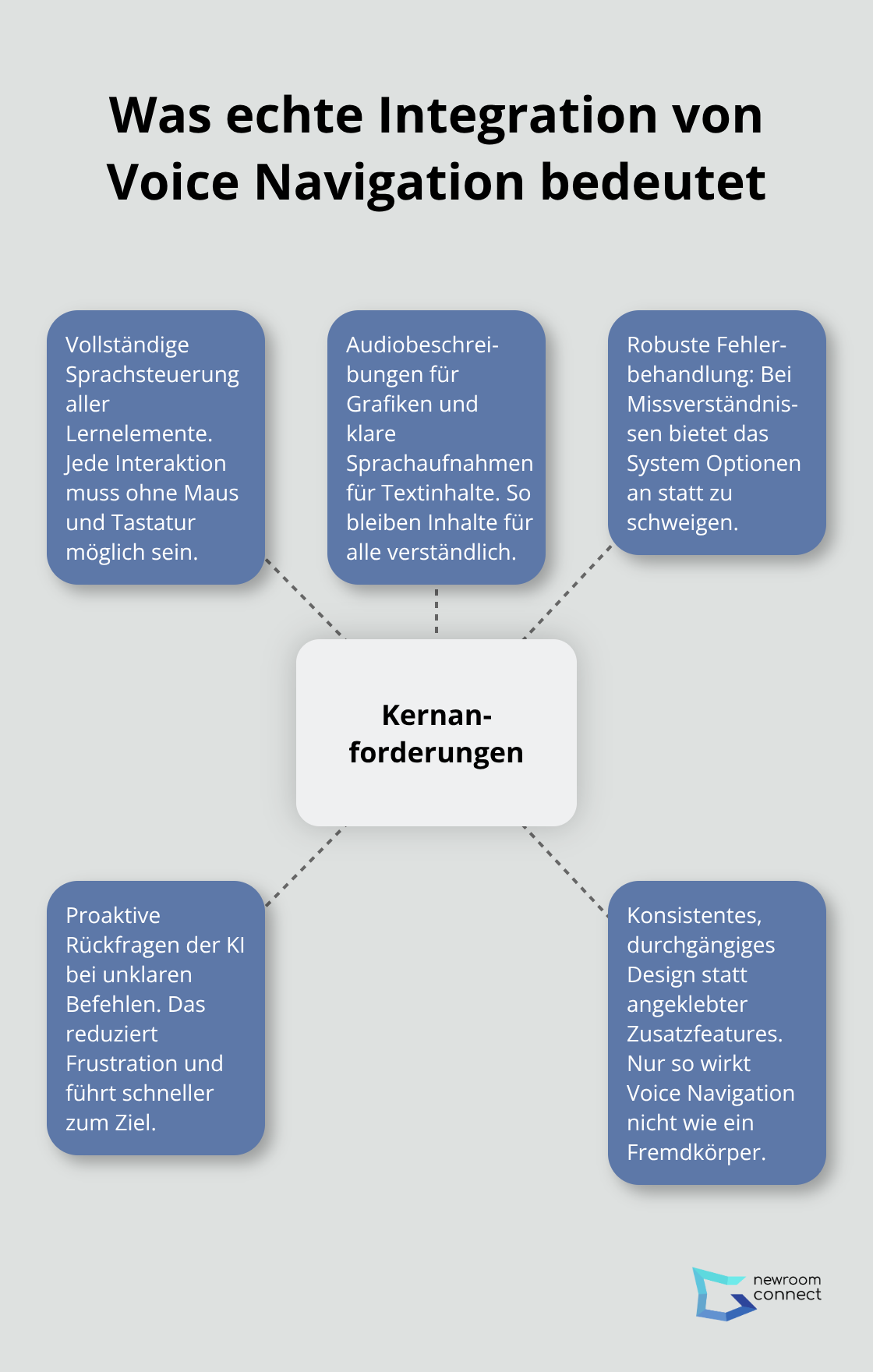

Barrierefreiheit funktioniert nur, wenn sie von Anfang an mitgedacht wird. Voice Navigation darf nicht als Zusatzfeature wirken, das für eine kleine Gruppe bolzengeklebt ist – sie muss in die Kernarchitektur der Plattform eingebaut sein. Das bedeutet konkret: Jedes Element der Lernumgebung (Videos, Bilder, Texte, Übungen) muss vollständig über Sprache nutzbar sein. Automatische Audiobeschreibungen für Grafiken, klare Sprachaufnahmen für alle Textinhalte und robuste Fehlerbehandlung gehören dazu. Wenn die KI einen Sprachbefehl nicht versteht, darf sie nicht einfach schweigen, sondern muss Optionen anbieten oder Fragen stellen. Plattformen, die Voice Navigation nur oberflächlich integrieren, helfen letztlich niemandem – sie schaffen sogar Frustration, weil Nutzer auf Features treffen, die nicht sprachgesteuert funktionieren (und dann wieder auf traditionelle Bedienung ausweichen müssen). Echte Barrierefreiheit ist ein Qualitätsmerkmal, das allen zugute kommt, nicht nur Menschen mit Beeinträchtigungen.

Diese Grundlage ist entscheidend, bevor du dich mit den praktischen Anwendungen von Voice Navigation auseinandersetzt.

Wie funktioniert Voice Navigation im realen Lernalltag?

Voice Navigation wird erst dann wertvoll, wenn sie konkret im Lernalltag funktioniert. Der erste Schritt ist die sprachgesteuerte Kursnavigation, die ohne Umschweife funktionieren muss. Ein Lernender sagt beispielsweise „Öffne Datenschutz-Grundlagen, Kapitel 3″ und landet sofort dort – ohne Menü-Durcheinander. Moderne Spracherkennungssysteme wie Google Assistant oder Amazon Alexa erreichen dabei eine Erkennungsgenauigkeit von über 95 Prozent bei klaren Befehlen. Das bedeutet: In den meisten Fällen versteht das System beim ersten Versuch. Entscheidend ist, dass die Plattform vorausschauend arbeitet. Wenn du regelmäßig um 14 Uhr einen bestimmten Kurs öffnest, kann das System dir diesen proaktiv vorschlagen. Das spart Zeit und macht das Lernen deutlich flüssiger.

Transkription macht Inhalte durchsuchbar und flexibel

Bei der automatischen Transkription von Vorlesungen und Lernmaterialien zeigt sich ein weiterer praktischer Vorteil: Statt dass Lernende manuell Notizen schreiben, erfasst das System gesprochene Inhalte in Echtzeit und wandelt sie in durchsuchbares Text um. Laut Cognitive Load Theory verbessert die gleichzeitige Verfügbarkeit von Audio und Text die Informationsspeicherung um etwa 65 Prozent. Das ist besonders relevant für Menschen mit Dyslexie oder Aufmerksamkeitsdefiziten – sie können Inhalte in ihrer bevorzugten Form konsumieren (ob als Hörbeitrag oder Textversion). Die Transkripte werden zudem indiziert, sodass du später schnell Textstellen findest. Wenn du beispielsweise nach „Datenschutz in Kapitel 2″ suchst, zeigt dir das System alle relevanten Passagen sofort an. Das spart enorm Zeit bei der Wiederholung von Lernmaterialien und macht das Wissen tatsächlich abrufbar.

Sprach-basierte Quizze aktivieren statt passiv zu unterrichten

Sprach-basierte Quiz und interaktive Übungen transformieren das Lernen von einer passiven zu einer aktiven Erfahrung. Statt Multiple-Choice-Fragen anzuklicken, antwortet der Lernende mündlich und erhält unmittelbare Rückmeldung: „Deine Antwort ist korrekt. Die Datenschutz-Grundverordnung trat 2018 in Kraft. Möchtest du die nächste Frage?“ Das System kann sogar Zwischentöne erkennen – wenn jemand unsicher antwortet, kann es zusätzliche Erklärungen anbieten, bevor es weitermacht. Ein wichtiger praktischer Punkt: Sprachgesteuerte Quizze ermöglichen echte Mehrsprachigkeit. Ein Kurs kann gleichzeitig auf Deutsch, Englisch und Französisch laufen, ohne dass separate Versionen nötig sind. Das Text-to-Speech-System passt sich an, und der Lernende antwortet in seiner Sprache. Für international tätige Unternehmen spart das erhebliche Entwicklungskosten.

Höhere Abschlussquoten durch niedrigere Hürden

Zudem zeigt sich in der Praxis, dass sprachgesteuerte Übungen die Abschlussquoten von Online-Kursen messbar erhöhen – weil die Hürde zur Teilnahme sinkt. Menschen mit Sehbehinderungen oder motorischen Einschränkungen, die traditionelle E-Learning-Plattformen meiden, nutzen sprachgesteuerte Formate aktiv. Das ist nicht nur eine Frage der Inklusion, sondern auch der Geschäftslogik: Mehr Teilnehmer bedeuten bessere Datengrundlagen und höhere Erfolgsquoten für Schulungsprogramme. Wenn du Voice Navigation richtig einsetzt, öffnest du deine Lernplattform für eine deutlich größere Zielgruppe. Das führt uns zur nächsten Frage: Welche technologischen Grundlagen brauchst du, um Voice Navigation wirklich robust und zuverlässig zu machen?

Welche Technologien machen Voice Navigation in E-Learning wirklich zuverlässig?

Natural Language Processing (NLP) ist das Fundament, auf dem Voice Navigation funktioniert. NLP ermöglicht es Systemen, nicht nur Worte zu erkennen, sondern auch die Absicht hinter ihnen zu verstehen. Wenn ein Lernender sagt „Zeig mir die Aufgaben zu Compliance“, versteht das System, dass es nicht nach dem Wort „Compliance“ suchen soll, sondern nach Übungen, Quizzen oder Aufgaben zum Thema Compliance. Das ist entscheidend, weil Lernende selten exakt dieselben Befehle verwenden. Einer sagt „Öffne Quiz“, ein anderer sagt „Starte die Fragen“, ein dritter sagt „Ich möchte mich prüfen lassen“. Modernes NLP trainiert Systeme darauf, diese Variationen zu erkennen und korrekt zu interpretieren. Google und Microsoft haben hier Standards gesetzt – ihre Spracherkennungssysteme erreichen bei klaren Befehlen Genauigkeitsraten über 95 Prozent, was für produktive Lernumgebungen ausreicht. Der praktische Vorteil: Fehlerquoten sinken deutlich, wenn NLP kontinuierlich lernt. Jede Interaktion verbessert das Modell. Nach wenigen Wochen Nutzung durch eine Gruppe von Lernenden versteht das System lokale Besonderheiten, Dialekte und individuelle Sprachmuster besser.

Mehrsprachigkeit ohne separate Systeme aufbauen

Mehrsprachige Spracherkennung ist nicht länger ein Nice-to-Have, sondern eine geschäftliche Notwendigkeit. Unternehmen, die global tätig sind, können nicht für jede Sprache separate E-Learning-Plattformen unterhalten. Moderne Systeme erkennen die Sprache automatisch und wechseln ohne Umschweife. Ein Nutzer spricht Deutsch, der nächste Englisch, der dritte Französisch – alles läuft auf derselben Plattform. Das Wichtigste: Diese Mehrsprachigkeit funktioniert nur, wenn die Transkription und das Sprachverständnis auf derselben technologischen Basis laufen. Text-to-Speech-Systeme müssen in allen Sprachen eine konsistente Qualität liefern (sonst entsteht Verwirrung bei den Lernenden). Wenn die deutsche Stimme klar ist, die französische aber verzerrt klingt, verlieren Lernende das Vertrauen. Deshalb lohnt es sich, in bewährte Plattformen zu investieren, die mehrsprachige Verarbeitung von Grund auf designed haben, statt diese später anzupassen.

KI-Tutoren ergänzen Voice Navigation sinnvoll

KI-gestützte Tutorensysteme nehmen Voice Navigation auf die nächste Stufe. Sie transformieren die Spracherkennung von einer reinen Navigations-Funktion zu einem echten Lernbegleiter. Das System merkt sich nicht nur, welche Kapitel du öffnest, sondern auch, wo du Schwierigkeiten hast. Wenn du ein Quiz dreimal nicht bestandest, erkennt der KI-Tutor das Muster und schlägt vor: „Du hattest Probleme mit dem Thema Datensicherheit. Soll ich dir das in einfacherer Form erklären?“ Das ist deutlich wertvoller als eine starre Navigation. Entscheidend ist, dass dieser Tutor nicht nur reaktiv ist. Er kann proaktiv eingreifen, etwa wenn der Lernende länger als normal inaktiv ist, oder wenn die Fehlerquote in einem Bereich plötzlich ansteigt. Solche Systeme erhöhen nachweislich die Abschlussquoten von Online-Kursen. Unternehmen, die KI-Tutoren einsetzen, berichten von 20 bis 30 Prozent höheren Completion-Raten (das liegt daran, dass der Tutor den Lernenden nicht allein lässt). Für barrierefreie E-Learning ist das zentral: Ein KI-Tutor kann automatisch feststellen, ob ein Nutzer mit Sehbehinderung besondere Pausen braucht oder ob die Sprechgeschwindigkeit zu schnell ist, und passt sich in Echtzeit an.

Abschließende Gedanken zur Implementierung

Wähle eine Plattform, die Voice Navigation nicht als Zusatzfeature, sondern als Kernfunktion hat. Das bedeutet konkret: Spracherkennung mit über 95 Prozent Genauigkeit, konsistentes Text-to-Speech in allen Sprachen und vollständige Sprachsteuerung für alle Lernelemente – von Videos bis Quizze. newroom connect ermöglicht dir, barrierefreie Lernumgebungen zu schaffen, die von Anfang an für Sprachsteuerung designed sind und kontinuierlich dazulernen.

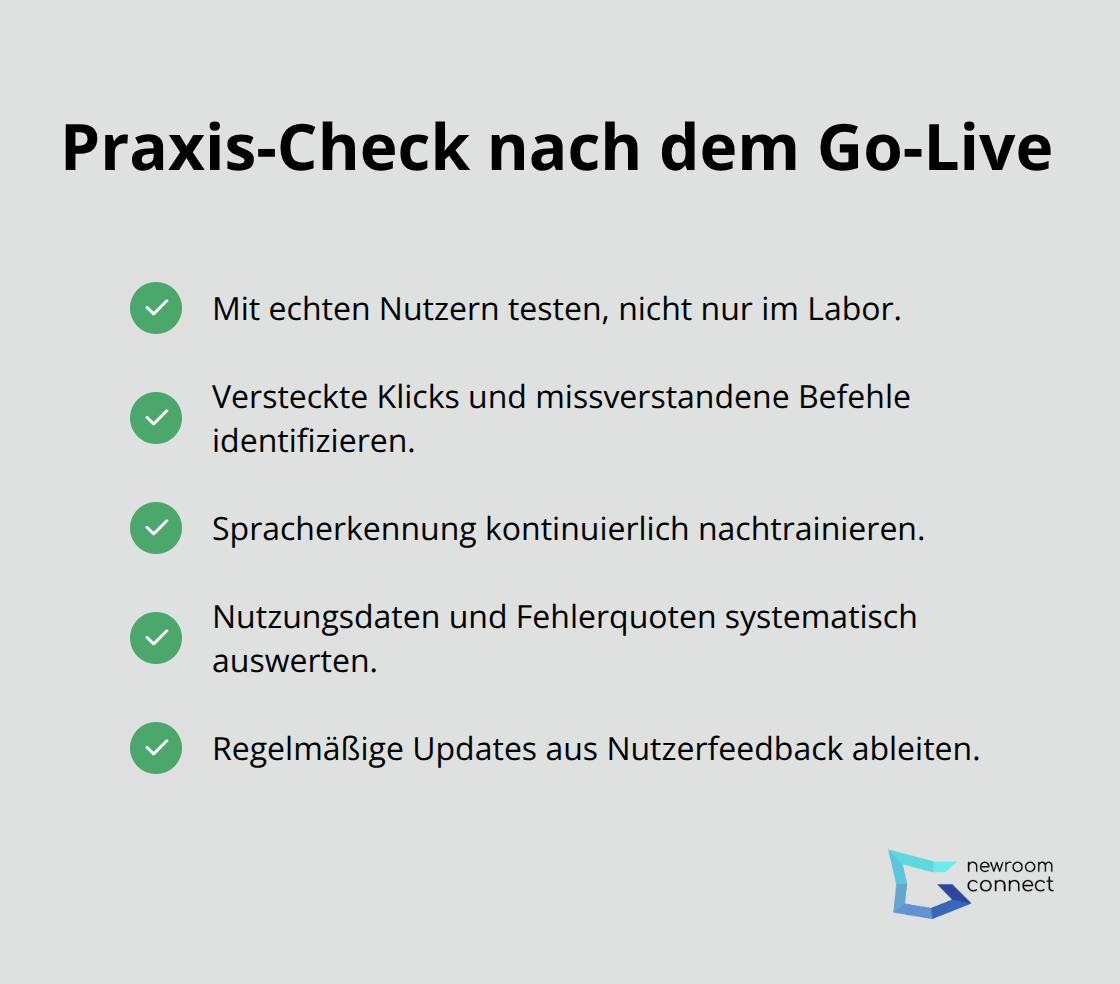

Teste deine Voice Navigation mit echten Nutzern, nicht nur im Labor. Menschen mit Sehbehinderungen, motorischen Einschränkungen und kognitiven Besonderheiten zeigen dir, wo dein System wirklich funktioniert und wo es scheitert. Ein blinder Nutzer sagt vielleicht „Nächstes Kapitel“, ein anderer „Springe zu Kapitel 5″ – dein System muss beide verstehen.

Nur echte Nutzer decken auf, wo versteckte Klicks noch nötig sind oder welche Befehle missverstanden werden.

Nach dem Launch beginnt die eigentliche Arbeit. Sammle systematisch Feedback, analysiere Fehlerquoten bei der Spracherkennung und beobachte, wo Nutzer zur Maus greifen. Wenn 20 Prozent der Nutzer „Quiz starten“ sagen, aber dein System nur „Quiz öffnen“ versteht, trainiere das System nach. Regelmäßige Updates basierend auf echtem Nutzerverhalten machen den Unterschied zwischen einer funktionierenden und einer wirklich guten barrierefreien Plattform.